Tyrėjai iš Anthropic ištyrė Claude 3.5 Haiku gebėjimą nuspręsti, kada pertraukti teksto eilutę fiksuoto pločio ribose, o tai reikalauja, kad modelis rastų savo padėtį. Tyrimas davė nuostabų rezultatą, kad kalbos modeliai sudaro vidinius modelius, panašius į erdvinį suvokimą, kurį žmonės naudoja sekdami vietą fizinėje erdvėje.

Andreasas Volpini tviteryje paskelbė apie šį dokumentą ir padarė analogiją su AI vartojimui skirto turinio išskaidymu. Platesne prasme jo komentaras veikia kaip metafora to, kaip ir rašytojai, ir modeliai naršo struktūroje, rasdami darną tose ribose, kur vienas segmentas baigiasi, o kitas prasideda.

Tačiau šis tyrimas skirtas ne turinio skaitymui, o teksto generavimui ir nustatymui, kur įterpti eilutės pertrauką, kad tekstas tilptų į savavališką fiksuotą plotį. To tikslas buvo geriau suprasti, kas vyksta LLM viduje, nes rašant ji stebi teksto padėtį, žodžių pasirinkimą ir eilutės pertraukos ribas.

Tyrėjai sukūrė eksperimentinę užduotį generuoti tekstą su eilutės pertrauka tam tikrame plotyje. Tikslas buvo suprasti, kaip Claude 3.5 Haiku nusprendžia, kokius žodžius tilpti į nurodytą plotį ir kada įterpti eilutės lūžį, todėl modeliui reikėjo sekti esamą vietą kuriamoje teksto eilutėje.

Eksperimentas parodo, kaip kalbos modeliai išmoksta struktūrą iš teksto šablonų be aiškaus programavimo ar priežiūros.

„Linebreaking Challenge“.

Eilučių laužymo užduotis reikalauja, kad modelis nuspręstų, ar kitas žodis tilps esamoje eilutėje, ar jis turi pradėti naują. Kad pasisektų, modelis turi išmokti linijos pločio apribojimą (taisyklė, ribojanti, kiek simbolių gali tilpti eilutėje, kaip fizinėje popieriaus lapo erdvėje). Norėdami tai padaryti, LLM turi sekti parašytų simbolių skaičių, apskaičiuoti, kiek liko, ir nuspręsti, ar tinka kitas žodis. Užduotis reikalauja samprotavimo, atminties ir planavimo. Tyrėjai naudojo priskyrimo grafikus, kad įsivaizduotų, kaip modelis koordinuoja šiuos skaičiavimus, parodydamas skirtingas vidines simbolių skaičiaus, kito žodžio ir momento, kai reikia pertraukti eilutę, ypatybes.

Nuolatinis skaičiavimas

Tyrėjai pastebėjo, kad Claude 3.5 Haiku vaizduoja linijos simbolių skaičių ne kaip skaičiuojant žingsnis po žingsnio, o kaip lygią geometrinę struktūrą, kuri elgiasi kaip nuolat lenktas paviršius, leidžiantis modeliui sklandžiai sekti padėtį (skrendant), o ne skaičiuoti simbolius po simbolio.

Dar kažkas įdomaus yra tai, kad jie atrado, kad LLM sukūrė ribos galvutę („dėmesio galvutę“), kuri yra atsakinga už linijos ribos aptikimą. Dėmesio mechanizmas pasveria to, kas yra svarstoma (žetonų) svarbą. Dėmesio galva yra specializuotas LLM dėmesio mechanizmo komponentas. Ribinė galvutė, kuri yra dėmesio galvutė, specializuojasi siauroje užduotyje – aptikti linijos pabaigos ribą.

Tyrimo dokumente teigiama:

„Vienas esminių linijų simbolių skaičiaus vaizdavimo bruožų yra tai, kad „ribos galvutė“ susuka vaizdą, todėl kiekvienas skaičius gali susiporuoti su šiek tiek didesniu skaičiumi, o tai rodo, kad riba yra arti. Tai yra, yra linijinis žemėlapis QK, kuris slenka simbolių skaičiaus kreivę išilgai savęs. Tokio veiksmo nepripažįsta bendras didelio kreivumo modelis, įterptas į fizinį apskritimo modelį, kaip įterpiamas intervalas. Tačiau tai yra ir kolekcijoje, kurią stebime Haiku, ir, kaip dabar parodome, Furjė konstrukcijoje.

Kaip veikia ribų jutimas

Lyginant du vidinius signalus, mokslininkai nustatė, kad Claude 3.5 Haiku žino, kada teksto eilutė beveik baigiasi:

- Kiek simbolių ji jau sugeneravo ir

- Kokio ilgio turėtų būti eilė.

Minėtos ribinės dėmesio galvutės nusprendžia, į kurias teksto dalis sutelkti dėmesį. Kai kurios iš šių galvų specializuojasi pastebėti, kai linija netrukus pasieks savo ribą. Jie tai daro šiek tiek pasukdami arba išdėstydami du vidinius signalus (simbolių skaičių ir didžiausią eilutės plotį), kad, kai jie beveik sutampa, modelio dėmesys būtų nukreiptas į eilutės lūžio įterpimą.

Tyrėjai paaiškina:

„Kad aptiktų artėjančią linijos ribą, modelis turi palyginti du dydžius: esamą simbolių skaičių ir linijos plotį. Mes randame dėmesio galvutes, kurių QK matrica sukasi vieną skaičiavimo kolektorių, kad sulygiuotų jį su kitu tam tikru poslinkiu, sukuriant didelį vidinį sandaugą, kai skaičių skirtumas patenka į tikslinį diapazoną. Kelios galvutės su skirtingais poslinkiais dirba kartu, kad tiksliai įvertintų likusius simbolius.

Finalinis etapas

Šiame eksperimento etape modelis jau nustatė, kiek jis yra arti linijos ribos ir kokio ilgio bus kitas žodis. Paskutinis žingsnis yra naudoti šią informaciją.

Štai kaip tai paaiškinama:

„Paskutinis linijos lūžio užduoties žingsnis yra sujungti linijos ribos įvertinimą su kito žodžio numatymu, kad būtų galima nustatyti, ar kitas žodis tilps į eilutę, ar linija turėtų būti nutraukta.

Tyrėjai išsiaiškino, kad tam tikros vidinės modelio ypatybės suaktyvėja, kai po kito žodžio linija viršys ribą, o tai veiksmingai tarnauja kaip ribos detektoriai. Kai taip nutinka, modelis padidina naujos eilutės simbolio nuspėjimo galimybę ir sumažina kito žodžio galimybę. Kitos funkcijos veikia priešingai: jos suaktyvinamos, kai žodis vis dar tinka, todėl sumažėja eilutės lūžio įterpimo tikimybė.

Kartu šios dvi jėgos, viena stumia linijos pertrauką, o kita ją sulaiko, subalansuoja, kad priimtų sprendimą.

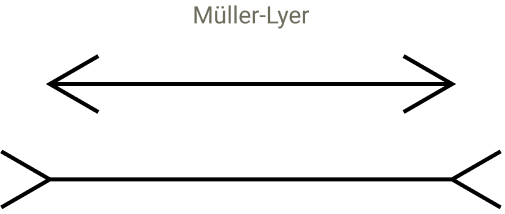

Ar modelis gali turėti vizualinių iliuzijų?

Kita tyrimo dalis yra neįtikėtina, nes jie stengėsi patikrinti, ar modelis gali būti jautrus vizualinėms iliuzijoms, kurios sukeltų jį. Jie prasidėjo nuo idėjos, kaip žmones galima apgauti vizualinėmis iliuzijomis, kurios pateikia klaidingą perspektyvą, dėl kurios vienodo ilgio linijos atrodo skirtingo ilgio, viena trumpesnė už kitą.

Vaizdinės iliuzijos ekrano kopija

Tyrėjai įterpė dirbtinius žetonus, tokius kaip „@@“, kad pamatytų, kaip jie sutrikdė modelio padėties pojūtį. Šie bandymai sukėlė modelio vidinių modelių, naudojamų padėties stebėjimui, nesutapimų, panašių į vizualines iliuzijas, kurios apgauna žmogaus suvokimą. Dėl to modelio linijos ribų pojūtis pasikeitė, parodydamas, kad jo struktūros suvokimas priklauso nuo konteksto ir išmoktų modelių. Nors LLM nemato, jie patiria savo vidinės organizacijos iškraipymus, panašius į tai, kaip žmonės neteisingai įvertina tai, ką mato, sutrikdydami atitinkamas dėmesio galvas.

Jie paaiškino:

„Pastebime, kad jis moduliuoja numatytą kitą prieigos raktą, sutrikdydamas naujos eilutės numatymą! Kaip ir buvo prognozuota, atitinkamos antraštės išsiblaško: pradiniame raginime antraštės dalyvauja nuo naujos eilutės iki naujos eilutės, pakeistoje eilutėje galvos taip pat atsižvelgia į @@.”

Jie domėjosi, ar @@ simboliuose yra kažkas ypatingo, ar kokie nors kiti atsitiktiniai simboliai sutrikdys modelio gebėjimą sėkmingai atlikti užduotį. Taigi jie atliko testą su 180 skirtingų sekų ir nustatė, kad dauguma jų nesutrikdė modelio galimybės numatyti linijos lūžio tašką. Jie išsiaiškino, kad tik nedidelė simbolių grupė, susijusi su kodu, galėjo atitraukti atitinkamą dėmesį ir sutrikdyti skaičiavimo procesą.

LLM turi vizualiai panašų teksto suvokimą

Tyrimas parodo, kaip teksto ypatybės išsivysto į sklandžias geometrines sistemas kalbos modelyje. Tai taip pat rodo, kad modeliai ne tik apdoroja simbolius, bet ir sukuria iš jų suvokimu pagrįstus žemėlapius. Ši dalis, susijusi su suvokimu, man yra tikrai įdomi tyrime. Jie nuolat grįžta prie analogijų, susijusių su žmogaus suvokimu, ir to, kaip tos analogijos vis įsilieja į tai, ką jie mato LLM viduje.

Jie rašo:

„Nors kartais apibūdiname ankstyvuosius kalbos modelių sluoksnius kaip atsakingus už įvesties „detokenizavimą“, galbūt labiau įtaigiau tai galvoti kaip apie suvokimą. Modelio pradžia iš tikrųjų yra atsakinga už įvesties matymą, o didžioji dalis ankstyvųjų grandinių yra skirta teksto jutimui ar suvokimui, panašiai kaip ankstyvieji regėjimo modelių sluoksniai įgyvendina žemo lygio suvokimą.

Tada šiek tiek vėliau jie rašo:

„Mūsų stebimi geometriniai ir algoritminiai modeliai turi įtaigių paralelių su suvokimu biologinėse nervų sistemose….Šie bruožai pasižymi išsiplėtimu – rodo vis didesnį simbolių skaičių, kuris aktyvuojasi vis didesniuose diapazonuose – atspindi skaičių vaizdų išsiplėtimą biologinėse smegenyse. Be to, ypatybių organizavimas mažų matmenų rinkinyje nėra tobulas biologinio motyvo pavyzdys. vis dar vaisingas sąvokų sutapimas dėl padidėjusio neurologijos ir interpretavimo bendradarbiavimo.

Poveikis SEO?

Arthuras C. Clarke'as rašė, kad pažangios technologijos niekuo nesiskiria nuo magijos. Manau, kad kai supranti technologiją, ji tampa labiau susieta ir mažiau panaši į magiją. Ne visos žinios yra naudingos, ir manau, kad suprasti, kaip LLM suvokia turinį, naudinga tiek, kiek jis nebėra stebuklingas. Ar šis tyrimas pagerins jūsų SEO? Tai gilina mūsų supratimą apie tai, kaip kalbos modeliai organizuoja ir interpretuoja turinio struktūrą, daro ją suprantamesnę ir mažiau panašią į magiją.

Apie tyrimą skaitykite čia:

Kai modeliai manipuliuoja kolektoriais: skaičiavimo užduoties geometrija

Teminis vaizdas, kurį sukūrė „Shutterstock“ / „Krot_Studio“.